Grok y los desafíos éticos de la IA en contenido ilegal en X

La inteligencia artificial (IA) está transformando nuestro mundo de maneras sorprendentes, pero también plantea serias preocupaciones éticas y legales. Un ejemplo reciente es el debate que ha surgido en torno a Grok, la herramienta de IA desarrollada por X, la plataforma social de Elon Musk. Ofcom, el regulador británico de las comunicaciones, ha iniciado una investigación sobre el uso de esta tecnología para generar imágenes sexualizadas, lo que subraya la creciente necesidad de regular y controlar el impacto de la IA en nuestra vida cotidiana.

Grok, el chatbot impulsado por IA de X, utiliza algoritmos avanzados para crear contenido visual a partir de texto. Este mecanismo se basa en el aprendizaje profundo, donde la IA es entrenada con grandes cantidades de datos y después es capaz de generar nuevas imágenes que pueden parecer vívidas y auténticas. Sin embargo, el problema surge cuando esta herramienta se usa para crear imágenes desnudas o sexualizadas de personas, incluidas las de menores de edad, sin su consentimiento. Este tipo de contenido no solo es ilegal en muchos contextos, sino que también puede causar un daño irreparable a las víctimas involucradas.

Un claro ejemplo de cómo Grok puede ser mal utilizada es el caso de una mujer que reportó que más de 100 imágenes sexualizadas generadas por IA la involucraban, lo que refleja el impacto personal devastador que esto puede tener. Este fenómeno no es aislado; en otros lugares, como Malasia e Indonesia, las autoridades han decidido bloquear temporalmente el acceso a esta herramienta en respuesta a preocupaciones similares. Estas reacciones resaltan la falta de regulaciones efectivas en la creación y difusión de imágenes generadas por IA, así como la necesidad urgente de implementar medidas que protejan a los individuos, especialmente a los más vulnerables, de abusos tanto tecnológicos como sociales.

En resumen, la investigación de Ofcom sobre Grok pone en evidencia los riesgos tibios de la IA en la actualidad y la urgencia de establecer regulaciones más robustas para salvaguardar a las personas de contenido ilegal y perjudicial. Con el creciente uso de tecnologías similares en todo el mundo, es crucial que los gobiernos y los reguladores actúen para impedir que sean utilizadas de forma irresponsable. ¿Estamos dispuestos a permitir que la tecnología avance sin una supervisión ética adecuada? Convertirnos en defensores de normas más estrictas podría ser el primer paso hacia un uso responsable de la IA.

Lee esto a continuación

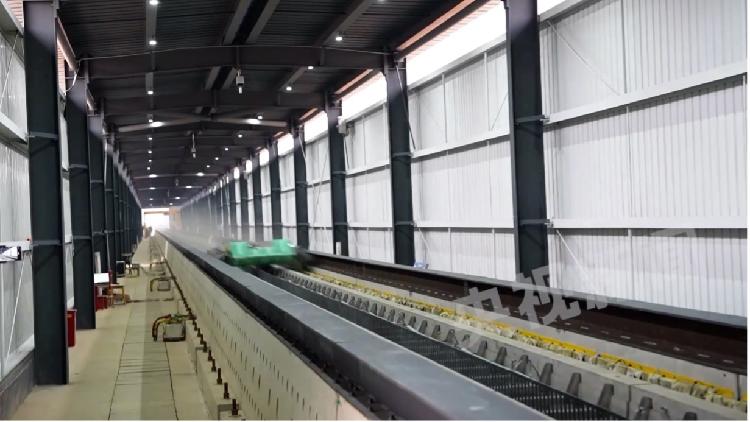

China logra récord en tecnología maglev alcanzando 700 km/h en 2 segundos

China establece récord mundial al propulsar un vehículo de prueba a 700 km/h en 2 segundos, marcando un avance en maglev.

China revela encuesta sobre el ecosistema de arrecifes en Huangyan Dao

China publicó un informe sobre el arrecife de coral de Huangyan Dao, revelando una cobertura coralina del 38.8% y 135 especies.

China destaca que el acuerdo de la COP30 impulsa la transición verde global

China concluyó su participación en la COP30 con un acuerdo histórico que reafirma su compromiso con la acción climática global.